符号约定

| 符号 |

说明 |

| X,Y,⋯ |

随机事件集合/随机变量 |

| x,y,⋯ |

随机事件集合中的元素/随机变量的取值 |

| p(x) |

随机事件发生的概率 |

| p(x∣y) |

随机事件发生的条件概率 |

| p(xy),p(x,y) |

随机事件发生的联合概率 |

概念说明

| 名称 |

说明 |

| 自信息量 |

随机事件集合 X 中某一个事件 x 的信息量,表示事件 x 的不确定性 |

| 互信息量 |

随机事件集合 X 中事件 x 包含事件 y 的信息量,表示事件 x 和事件 y 共有的不确定性 |

| 熵 |

随机事件集合 X 中所有事件自信息量的平均值,表示随机事件集合 X 的平均不确定性 |

| 互信息 |

随机事件集合 X 包含随机事件集合 Y 的熵,表示随机事件集合 X 与 Y 共有的平均不确实性 |

1. 随机事件

1.1 信息量与不确定度

事件发生的概率越大,它发生后提供的信息量就越小;事件发生的概率越小,一旦该事件发生,它发生后提供的信息量就越大。因此,事件 x 的信息量 I(x) 应该是该事件概率的函数

\begin{align*}

I(x) = f[p(x)] \tag{1.1}

\end{align*}

函数 I(x) 应满足的四大性质:

- f[p(x)] 应该是 p(x) 的单调递减函数;

- 当 p(x)=1 时,f[p(x)]=0;

- 当 p(x)=0 时,f[p(x)]=∞;

- 两个独立事件的联合信息量应该等于各自信息量之和。

1.2 自信息量

-

定义:任何随机事件的自信息量定义为该事件发生概率的对数的负值。假设事件 x 发生的概率为 p(x),则其自信息定义为

\begin{align*}

I(x) = -\log_{2} p(x) \tag{1.2}

\end{align*}

自信息量衡量的是随机事件的不确定性。事件的不确定性越大,其自信息量也越大,反之亦然。

-

性质:式 (1.2) 中定义的自信息满足式 (1.1) 中 f[p(x)] 应当满足的四大性质,即

-

函数 I(x) 是 p(x) 的递减函数;

-

当 p(x)=1 时,I(x)=0;

-

当 p(x)=0 时,I(x)=∞;

-

两个独立事件的联合信息量等于各自信息量之和

I(x1x2)=−log2p(x1x2)=−log2p(x1)p(x2)=I(x1)+I(x2)

-

单位及换算

|

单位 |

| I(x)=−log2p(x) |

bit (比特) |

| I(x)=−lnp(x) |

nat (奈特) |

| I(x)=−lgp(x) |

hart (哈特) |

1 nat = log2e = 1.443 bit

1 hart = log210 = 3.32 bit

1.3 联合自信息量

1.4 条件自信息量

1.5 互信息量

1.6 条件互信息量

-

定义:联合事件集 XYZ 中,在给定 z 的条件下,x 与 y 之间的互信息量称为条件互信息量,定义为:

\begin{align*}

I(x;y|z) = \log_{2}{p(x|yz) \over p(x|z)} \tag{1.6}

\end{align*}

条件互信息量衡量的是已知了 z 后,y 提供关于 x 的信息量

-

性质:I(x;y∣z)=I(x;yz)−I(x;z)。

证明:I(x;y∣z)=log2p(x∣z)p(x∣yz)=log2p(x∣z)p(x)p(x∣yz)p(x)=log2p(x)p(x∣yz)−log2p(x)p(x∣z)=I(x;yz)−I(x;z)

2. 离散事件集

离散事件集 X=x1,x2,⋯,xq,其概率分布表示为:

[XP]=[x1p(x1)x2p(x2)⋯⋯xqp(xq)]

2.1 熵

假设 X 中的每一个事件的自信息量分别为:I(x1)I(x2)⋯I(xq),则所有这些自信息量的均值即为 X 的平均自信息量,称为 X 的熵。

-

定义:离散事件集 X 中,事件的自信息量 I(x) 的数学期望定义为平均自信息量:

\begin{align*}

H(X) = E_X[I(x)] = E_X[-\log_{2}p(x)] = -\sum_X p(x)\log_{2}p(x) \tag{2.1}

\end{align*}

又称作集 X 的信息熵,简称熵,H(X) 又可记作 H(p1,p2,⋯,pq) 。

-

性质:H(X)≥0

证明:源自自信息量的非负性

H(X)=EX[I(x)]=∑Xp(x)log2p(x)1

当有且仅有一个 p(xi)=1,其余的 p(xj)=0 时,H(X)=0,即确定事件集。

-

单位及换算:同自信息量。

2.2 条件熵

-

定义:条件自信息量 I(x∣y) 的概率均值称为条件熵,定义为:

\begin{align*}

H(X|Y) = E_{XY}[I(x|y)] = \sum_{XY}p(xy)I(x|y) = -\sum_{XY}p(xy)\log_{2}p(x|y) \tag{2.2}

\end{align*}

条件熵衡量的是离散事件集 X 在已知离散事件集 Y 后仍然保留的平均不确定性。

设 H(X∣y)=−∑Xp(x∣y)log2p(x∣y) 表示 y 确定时,集合 X 保留的平均不确定性。则

H(X∣Y)=∑Yp(y)H(X∣y)=−∑XYp(y)p(x∣y)log2p(x∣y)=−∑XYp(xy)log2p(x∣y)

-

性质:H(X∣Y)≥0

证明:因为 H(X∣Y)=∑Yp(y)H(X∣y),且 H(X∣y)≥0。

若 X 表示输入,Y 表示输出,则 H(X∣Y) 表示信道损失。若 X 与 Y 独立,易得 H(X∣Y)=H(X)。

2.3 联合熵

-

定义:联合事件集 XY 上,联合自信息量 I(xy) 的概率均值称为联合熵,定义式如下:

\begin{align*}

H(XY) = E_{XY}[I(xy)] = \sum_{XY}p(xy)I(xy) = -\sum_{XY}p(xy)\log_{2}p(xy) \tag{2.3}

\end{align*}

联合熵又称为共熵,也可以记为 H(X,Y)。

推广:设 X1,X2,⋯,Xk 为一组离散事件集合,则 X1,X2,⋯,Xk 的联合熵定义为:

H(X1,X2,⋯,Xk)=−∑X1,X2,⋯,Xkp(x1,x2,⋯,xk)log2p(x1,x2,⋯,xk)

2.4 互信息

-

定义:离散事件集合 X 包含离散事件 Y 的平均信息量称为平均互信息量,简称互信息,定义为

\begin{align*}

I(X;Y) = E_{XY}[I(x; y)] = -\sum_{XY} p(x y) \log_{2} \frac{p(x|y)}{p(x)} = -\sum_{XY} p(x y) \log_2 \frac{p(xy)}{p(x) p(y)} \tag{2.4}

\end{align*}

-

性质:

-

非负性:I(X;Y)≥0;

证明:I(X;Y)=H(X)−H(X∣Y)≥0(证明见下文)

-

互易性(对称性):从集合 Y 中获得的关于 X 的信息量等于从集合 X 中获得的关于 Y 的信息量,即 I(X;Y)=I(Y;X);

证明:I(X;Y)=∑XYp(xy)I(x;y)=∑YXp(yx)I(y;x)=I(Y;X)

-

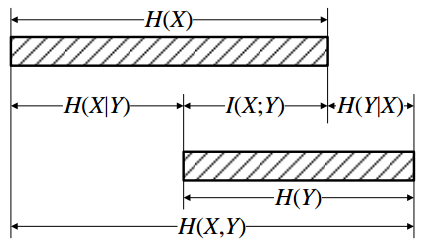

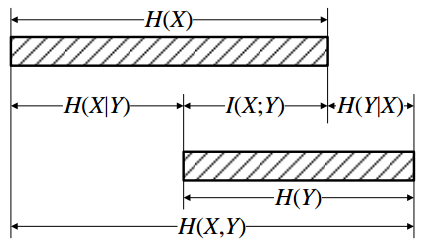

互信息与各类熵的关系:I(X;Y)=H(X)−H(X∣Y)=H(Y)−H(Y∣X)=H(X)+H(Y)−H(X,Y)(证明见下文)

- 当 Y 决定 X 时,即 H(X∣Y)=0,有 I(X;Y)=H(X);

- 当 X 决定 Y 时,即 H(Y∣X)=0,有 I(X;Y)=H(Y);

- 当 X 与 Y 相互独立时,H(X∣Y)=H(X),即 I(X;Y)=0。

-

极值性:I(X;Y)≤min{(H(x),H(Y))};

证明:因为 I(X;Y)=H(X)−H(X∣Y),且 H(X∣Y)≥0。

-

凸函数性:互信息是先验概率 p(x) 的上凸函数,是前向转移概率 p(y∣x) 的下凸函数。

- 当信道固定时, 选择不同的信源( 其概率分布不同) ,在信道输出端接收到每个符号获得的平均信息量是不同的;当信源固定时,选择不同的信道(其转移概率分布不同)来传输同一信源符号时,在信道输出端接收到每个符号获得的平均信息量是不同的。

- 对于一个固定的信源,一定存在着一种信源,使得输出端获得的平均信息量最大;对于一个固定的信源,一定存在着一种最差的信道,使得输出端获得的平均信息量最小。

3. 信息统计量的相关性质

3.1 熵函数的数学特性

-

对称性:集合中各分量的次序任意变更时,熵值不变,即

\begin{gather*}

H(p_1,p_2) = H(p_2,p_1) \\

H(p_1,p_2,\cdots,p_n) = H(p_2,p_1,\cdots,p_n) = H(p_n,p_1,\cdots,p_{n-1})

\end{gather*}

证明:H(X)=−∑i=1np(xi)log2p(xi)

换句话说,熵是有局限性的。因为它仅与随机事件集合的总体结构有关,没有考虑随机事件间的顺序,抹杀了个体的特性。

-

非负性:H(X)≥0;

证明:源自自信息量的非负性

H(X)=EX[I(x)]=∑Xp(x)log2p(x)1

当有且仅有一个 p(xi)=1,其余的 p(xj)=0 时,H(X)=0,即确定事件集。

-

扩展性:limε→0Hq+1(p1,p2,⋯,pq−ε,ε)=Hq(p1,p2,⋯,pq);

证明:xlog2x 在 [0,∞) 上的连续性,limx→0xlog2x=0

也即是说,随机事件集合 X 有 q 个事件,随机事件集合 Y 比 X 仅仅是多了一个概率接近 0 的事件,则两个集合的熵值一样。换句话说,在随机事件集合中,若一个事件发生的概率比其它事件发生的概率小得多时,则这个事件对于集合的熵值的贡献可以忽略。

-

可加性:设 X 和 Y 为两个互相关联的随机事件集合,X 的概率分布为 {p1,p2,⋯,pm},Y 的概率分布为 {q1,q2,⋯,qn},则

H(XY)=H(X)+H(Y∣X)=H(Y)+H(X∣Y)

证明:

H(XY)=======−∑XYp(xy)log2p(xy)−∑XYp(xy)log2p(y∣x)p(x)−∑Xp(x)log2p(x)−∑XYp(xy)log2p(y∣x)H(X)+H(Y∣X)−∑XYp(xy)log2p(x∣y)p(y)−∑Yp(y)log2p(y)−∑XYp(xy)log2p(x∣y)H(Y)+H(X∣Y)

当 X、Y 相互独立时,H(XY)=H(X)+H(Y) 。

可以将可加性推广到多个随机事集合:

-

熵的可加性可推广到多个随机事件集合的情况:

H(X1X2⋯XN)=H(X1)+H(X2∣X1)+H(X3∣X1X2)+⋯+H(XN∣X1X2⋯XN−1)

-

当这些随机变量统计独立时:

H(X1X2⋯XN)=H(X1)+H(X2)+⋯+H(XN)

-

极值性:H(X)=H(p1,p2,⋯,pn)≤H(n1,n1,⋯,n1)=log2n;因此,各事件等概率发生时,熵最大(最大熵定理)。

证明:H(X)=−∑Xp(x)log2p(x),而 f(x)=−xlog2x 函数在区间 [0,1] 上为严格上凸函数(证明见下文上凸性),故由琴生不等式(参见凸函数及其性质)可知:

H(X)==≤==E[I(x)]E[f[p(x)]]f[E[P(xi)]]−log2n1log2n

等号成立当且仅当

p(x1)=p(x2)=⋯=p(xn)=n1

凸函数定义及相关性质参见凸函数及其性质。

-

确定性:集合中只要有一个事件为必然事件,则其余事件为不可能事件,此时熵为 0 。

H(1,0)=H(1,0,0)=⋯=H(1,0,⋯,0)=0

-

上凸性:H(p1,p2,⋯,pq) 是概率分布 (p1,p2,⋯,pq) 上的严格上凸函数。

证明:设 p 和 p′ 分别为两个概率分布,p=p′ 且 0<α<1,则需证明

H[αp+(1−α)p′]>αH(p)+(1−α)H(p′)

由于函数 f(x)=−xlog2x 在区间 [0,1] 是严格上凸函数,证明如下:

-

对于 0<α<1,任取 0≤x1,x2≤1 且 x1=x2,不妨假设 0≤x1<x2≤1,要证

=>f[αx1+(1−α)x2]−αf(x1)−(1−α)f(x2)−(αx1+(1−α)x2)log2(αx1+(1−α)x2)+αx1log2x1+(1−α)x2log2x20

-

若 x1=0,则上式等价于

⇔−(1−α)x2log2((1−α)x2)+(1−α)x2log2x2>0(1−α)x2log2(1−α)1>0

易知对于 0<α<1 恒成立。

-

若 x1=0,则上式等价于

⇔−αx1log2(α+(1−α)x1x2)−(1−α)x2log2(αx2x1+(1−α))>0αlog2(α+(1−α)x1x2)+(1−α)x1x2log2(αx2x1+(1−α))<0

令 t=x1x2,则 t>1,上式等价于

αlog2(α+(1−α)t)+(1−α)tlog2(αt1+(1−α))<0

令 h(t)=αlog2(α+(1−α)t)+(1−α)tlog2(αt1+(1−α)),t>1,则

h′(t)=(1−α)log2(αt1+(1−α))

易知 h′(t) 在 t>1 上递减,故 h′(t)<h′(1)=0。所以 h(t) 在 t>1 上递减,因此 h(t)<h(1)=0+0=0。即

αlog2(α+(1−α)t)+(1−α)tlog2(αt1+(1−α))<0

综上,函数 f(x)=−xlog2x在区间 [0,1] 上是严格上凸函数。

证明了 f(x)=−xlog2x 为严格上凸函数后,回到证明 H(p1,p2,⋯,pq) 的上凸性。由于 0<α<1,∑i=1np(xi)=1,∑i=1np′(xi)=1:

H(p)H(p′)H(αp+(1−α)p′)===−∑i=1np(xi)log2p(xi)−∑i=1np′(xi)log2p′(xi)−∑i=1n(αp(xi)+(1−α)p′(xi))log2(αp(xi)+(1−α)p′(xi))

由函数 f(x)=−xlog2x 的严格上凸性和凸函数及其性质可知,∀i∈{1,2,⋯,n},都有:

≥−(αp(xi)+(1−α)p′(xi)log2((αp(xi)+(1−α)p′(xi))−αp(xi)log2p(xi)−(1−α)p′(xi)log2p′(xi)

成立,且等号成立当且仅当 p(xi)=p′(xi)。由假设可知,p=qp′,故

>−∑i=1n(αp(xi)+(1−α)p′(xi)log2((αp(xi)+(1−α)p′(xi))−∑i=1n(αp(xi)log2p(xi)+(1−α)p′(xi)log2p′(xi))

也即

H[αp+(1−α)p′]>αH(p)+(1−α)H(p′)

故命题得证。

3.2 各种熵之间的关系

-

H(XY)=H(X)+H(Y∣X)=H(Y)+H(X∣Y)

-

H(X∣Y)≤H(X),等式成立当且仅当 X 和 Y 相互独立

证明:

H(X∣Y)====≤−∑XYp(xy)log2p(x∣y)−∑XYp(xy)log2p(y)p(x)p(xy)p(x)H(X)−∑XYp(xy)log2p(x)p(y)p(xy)H(X)+∑XYp(xy)log2p(xy)p(x)p(y)H(X)

-

H(XY)≤H(X)+H(Y)

3.3 加权熵

- 定义:离散事件集 X=x1,x2,⋯,xq,其概率分布和权重分布表示为:

⎣⎢⎡XPW⎦⎥⎤=⎣⎢⎡x1p(x1)w1x2p(x2)w2⋯⋯⋯xnp(xn)wn⎦⎥⎤

其中,wi≥0。则加权熵定义为:

HW(X)=−∑i=1nwip(xi)log2p(xi)

3.4 其它熵